Aritalab:Lecture/NetworkBiology/Watts-Strogatz Model

m (→一般の場合) |

m |

||

| Line 10: | Line 10: | ||

* Watts DJ, Strogatz SH. "Collective dynamics of 'small-world' networks.". Nature 393 (6684):409–10, 1998. [http://www.ncbi.nlm.nih.gov/sites/entrez?db=pubmed&uid=9623998&cmd=showdetailview&indexed=google doi:10.1038/30918] | * Watts DJ, Strogatz SH. "Collective dynamics of 'small-world' networks.". Nature 393 (6684):409–10, 1998. [http://www.ncbi.nlm.nih.gov/sites/entrez?db=pubmed&uid=9623998&cmd=showdetailview&indexed=google doi:10.1038/30918] | ||

* Durrett R. "Random Graph Dynamics" Cambridge University Press, 2004. | * Durrett R. "Random Graph Dynamics" Cambridge University Press, 2004. | ||

| + | |||

| + | ==次数相関== | ||

| + | 本題に入る前に、隣接する頂点の次数分布について復習します。隣接する頂点どうしの次数が似る度合いを次数相関といいます。 | ||

| + | 辺がランダムに張られる場合は次数相関は0になりますが、映画俳優の競演関係といったネットワークはハブどうしが隣接する、つまり正の相関を持つ (assortative) ことが知られています。 | ||

| + | 生態系のような生物学ネットワークでは負の相関を持つ (disassortative) と考えられます。 | ||

| + | |||

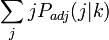

| + | 次数相関の存在は次数 ''k'' の頂点につながる頂点の平均次数を調べるとわかります。これを <math> \sum_j j P_{adj}(j|k) </math> と書きましょう。 | ||

| + | |||

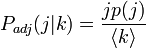

| + | ここで次数 ''k'' と隣接する頂点の次数 ''j'' との相関が0ならば、 | ||

| + | 次数が ''j'' の頂点は相対的に <math>\frac{j}{\langle k \rangle}</math> だけ、隣にきやすいため | ||

| + | |||

| + | <math> P_{adj}(j|k) = \frac{jp(j)}{\langle k \rangle} </math> | ||

| + | |||

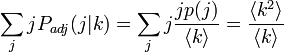

| + | となります。このとき隣接する頂点の平均次数は | ||

| + | |||

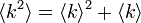

| + | <math> \sum_j j P_{adj}(j|k) = \sum_j j \frac{jp(j)}{\langle k \rangle} = \frac{\langle k^2 \rangle}{\langle k \rangle}</math> | ||

| + | |||

| + | で、次数分布や ''k'' によらず一定値となります。 | ||

| + | |||

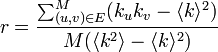

| + | 次数相関 ''r'' をピアソンの相関係数に従って定義しましょう。''M'' 本ある辺の両端点 ''u'', ''v'' の次数をそれぞれ ''k_u'', ''k_v'' とおきます。相関係数の分子は ''k_u'', ''k_v'' の平均からの差分を計算します。 | ||

| + | 分母は ''k_u'' と ''k_v'' の標準偏差の積ですが、実際には分散を計算します。 | ||

| + | |||

| + | |||

| + | <math>r = \frac{\sum_{(u,v)\in E}^M (k_u k_v - \langle k \rangle^2) }{M (\langle k^2 \rangle - \langle k \rangle^2) } </math> | ||

| + | |||

Revision as of 07:40, 30 June 2011

| Wiki Top | Up one level | レポートの書き方 | Arita Laboratory |

|

スモールワールド

ディズニーランドに It's a Small World というアトラクションがあります。友達という概念をネットワークで表現すると、世間の狭さは平均頂点間距離 L が小さいことに相当します。現実のネットワークは平均頂点間距離 L およびクラスター係数 C が大きい ( L = O(log N), C = 0.2 ∼ 0.3 ) ことが特徴です。

ランダムグラフ (Erdos-Renyi Model) は L が小さいものの、C が大きくなりません。 逆に格子グラフは L も C も大きくなります。これら二つのグラフの特徴を併せ持つモデルを Watts と Strogatz が提唱して一大ブームになりました。

歴史と参考図書

- Watts DJ, Strogatz SH. "Collective dynamics of 'small-world' networks.". Nature 393 (6684):409–10, 1998. doi:10.1038/30918

- Durrett R. "Random Graph Dynamics" Cambridge University Press, 2004.

次数相関

本題に入る前に、隣接する頂点の次数分布について復習します。隣接する頂点どうしの次数が似る度合いを次数相関といいます。 辺がランダムに張られる場合は次数相関は0になりますが、映画俳優の競演関係といったネットワークはハブどうしが隣接する、つまり正の相関を持つ (assortative) ことが知られています。 生態系のような生物学ネットワークでは負の相関を持つ (disassortative) と考えられます。

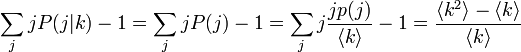

次数相関の存在は次数 k の頂点につながる頂点の平均次数を調べるとわかります。これを  と書きましょう。

と書きましょう。

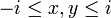

ここで次数 k と隣接する頂点の次数 j との相関が0ならば、

次数が j の頂点は相対的に  だけ、隣にきやすいため

だけ、隣にきやすいため

となります。このとき隣接する頂点の平均次数は

で、次数分布や k によらず一定値となります。

次数相関 r をピアソンの相関係数に従って定義しましょう。M 本ある辺の両端点 u, v の次数をそれぞれ k_u, k_v とおきます。相関係数の分子は k_u, k_v の平均からの差分を計算します。 分母は k_u と k_v の標準偏差の積ですが、実際には分散を計算します。

Watts-Strogatz Model

各頂点が  個の隣接点に接続した環状の格子グラフにおいて(総辺数は

個の隣接点に接続した環状の格子グラフにおいて(総辺数は )、確率

)、確率  で辺を張り直したものをWatts-Strogatzモデルといいます。パラメータ

で辺を張り直したものをWatts-Strogatzモデルといいます。パラメータ  を調節して格子とランダムグラフの中間状態を作成するところがポイントです。

を調節して格子とランダムグラフの中間状態を作成するところがポイントです。

p = 0 のとき

ネットワークは環状の格子グラフです。頂点の次数は全て k です。以下に記すようにクラスター係数が大きい代わりに、平均頂点間距離は O( n ) になります。

- クラスター係数

簡単のため左右の隣接点に同じ本数リンクを張ると仮定し、  とします。注目する点を原点とした

とします。注目する点を原点とした  のxy座標系を考えます。辺を張るときの端点をそれぞれ x, y と考えると、座標系の中で 2 i + 1 個の頂点間をむすぶ組み合わせは

のxy座標系を考えます。辺を張るときの端点をそれぞれ x, y と考えると、座標系の中で 2 i + 1 個の頂点間をむすぶ組み合わせは  の領域に属する

の領域に属する  個と考えられます。このうち

個と考えられます。このうち  に属する部分にはリンクが張られます。その割合(面積)を考えると

に属する部分にはリンクが張られます。その割合(面積)を考えると  です。

です。

- 平均頂点間距離

1ステップで  点スキップでき、環状格子で一番離れている点は

点スキップでき、環状格子で一番離れている点は  なので、

なので、 となります。

となります。

p = 1 のとき

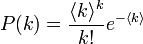

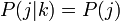

全ての辺をランダムに張り替えるので、ランダムグラフになります。 本の辺がポアソン過程で張られた場合を考えましょう。頂点の平均次数は

本の辺がポアソン過程で張られた場合を考えましょう。頂点の平均次数は  です。また全ての辺はランダムに張られるので、隣り合う頂点の間で次数の相関はありません。

です。また全ての辺はランダムに張られるので、隣り合う頂点の間で次数の相関はありません。

- クラスター係数

いかなる2頂点であろうと、その間に辺が存在する確率は  なので、

なので、 です。

です。

- 平均頂点間距離

ある頂点に隣接する頂点数の期待値は  個です。隣接点にさらに隣接する頂点数の期待値を求めましょう。

個です。隣接点にさらに隣接する頂点数の期待値を求めましょう。

1 を引いているのは、辿ってきた辺を除外するからです。また  とした部分に次数相関が 0 であることを使っています。この値はポアソン分布なら

とした部分に次数相関が 0 であることを使っています。この値はポアソン分布なら  であることから

であることから  になります。つまり、何個頂点をたどっても、その先に隣接する頂点の期待値は

になります。つまり、何個頂点をたどっても、その先に隣接する頂点の期待値は  です。

です。

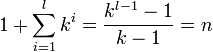

ここで、平均頂点間距離を l とおき、ある頂点から l ステップで到達しうる点の数を数えます。ネットワークのサイクルを考慮しないで(大雑把に)l ステップで全点 n に到達するとしましょう。

この関係から、大まかに  となります。

となります。

一般の場合

辺を張りなおすモデルだと理論的解析が難しいので、環状の格子グラフにポアソン過程に従って  本の辺を追加するモデルもよく使われます。

本の辺を追加するモデルもよく使われます。

- 平均頂点間距離

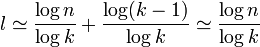

導出は面倒ですが以下の近似が知られています。

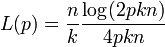

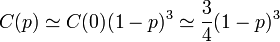

- クラスター係数

簡単な近似では、格子グラフにおいて隣接する頂点どうしが接続した三角形が  が辺の張り直しによって

壊れなければよいと考えます。辺が張り替えられる確率はそれぞれ p ですから 3 つとも張り替えられない確率は

が辺の張り直しによって

壊れなければよいと考えます。辺が張り替えられる確率はそれぞれ p ですから 3 つとも張り替えられない確率は

となります。